Wenn laut einem bekannten Sprichwort ein Bild „mehr als tausend Worte“ sagt, so stellt sich im Zuge der gegenwärtigen Entwicklungen virtueller Realitäten die Frage, was Mixed Reality „sagen“ kann bzw. wie viele Worte es ersetzen kann. Könnte diese Technologie zu einer besseren gegenseitigen Verständlichkeit beitragen?

Insbesondere in der Stadtplanung wären intuitive und anschauliche Kommunikationsmedien angebracht, um Verständigungsprobleme zu minimieren. Verkehrsplaner/innen, Schallschutzexperten/innen, Investoren/innen u. v. a. bringen sich in den Planungsprozess mit ihren fachrelevanten Interessen ein. Jenseits der rechtlichen Mindestanforderungen können sie dabei schnell Potenzial für Befürwortung verspielen, wenn ihr genutzter Fachjargon nicht allgemein verständlich ist. Was wäre nun, wenn in einem im Raum schwebenden Modell des Planungsgebietes, der Verkehrsplaner absehbare Szenarien des Berufsverkehrs, die Investorin die Wirtschaftlichkeitsbetrachtung der Nutzfläche und der Schallschutzexperte die zu erwartende Lärmausbreitung mit einer zusätzlichen Schallschutzwand, mit einem Klick für alle visualisieren könnten? Gewiss würden solche Anwendungen fachrelevanten Austausch keinesfalls ersetzen. Sie könnten jedoch im Abwägungsprozess die tatsächliche Bedeutung bspw. eines ökologischen Belangs – wie der zu erwartenden Smogwolke – auch für fachfremde Beteiligte überzeugender darstellen und den weiteren strategischen Ablauf maßgeblich bestimmen. Schon aus diesem Grund lohnt sich ein Einblick in die Mixed-Reality Technologie sowie ihre möglichen Potenziale speziell für die Stadtplanung.

1. Virtual, Augmented, Mixed Reality

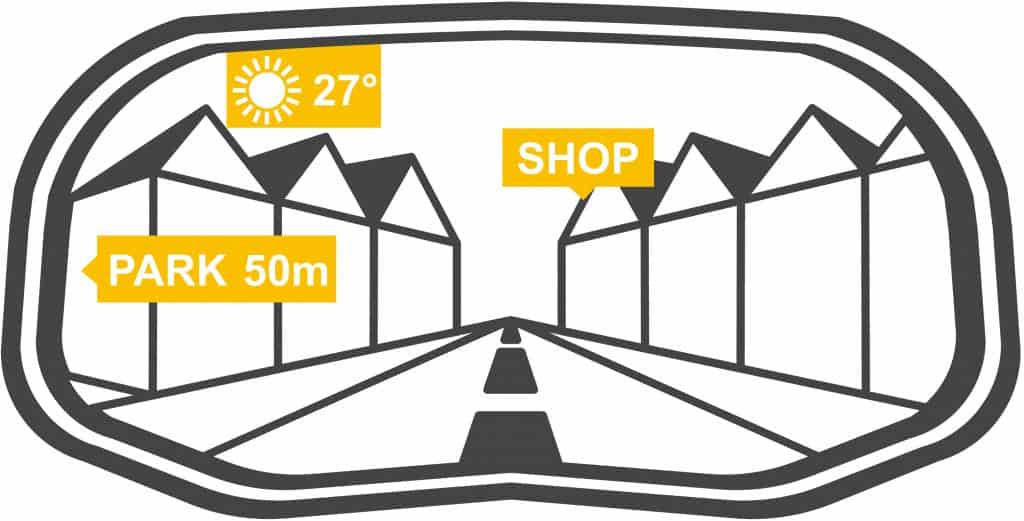

Für das bessere Verständnis von Mixed Reality sei vorerst der Bezug zu „Virtual Reality“ und „Augmented Reality“ verdeutlicht. Alle drei Technologien werden in der Regel über kopfgebundene Ausgabegeräte wahrgenommen, die in der Fachsprache als „head-mounted-displays“ (HMD) bezeichnet werden. Virtual Reality schirmt dabei, im Gegensatz zu den beiden anderen, das Sichtfeld komplett ab, indem das HMD die Nutzer/innen in eine gänzlich virtuelle Welt eintauchen lässt. Demgegenüber erlauben Augmented Reality und Mixed Reality mit ihren durchsichtigen Gläsern die Wahrnehmung der realen Welt und ergänzen diese in Echtzeit um virtuelle Darstellungen. Augmented Reality legt dabei eine 2D-Ebene mit virtuell dargestellten Texten und Grafiken auf die Realität. Hingegen können in Mixed Reality reale und virtuelle Objekte in der Realität in Echtzeit mit physischen Objekten „koexistieren“. So kann in Mixed Reality bspw. ein virtueller Hund auf dem physischen Boden eines Raumes vorbeilaufen und im Nachhinein hinter einem physischen Sofa verschwinden, wenn die Betrachtungsperspektive dies erfordert. (vgl. Pluralsight Technology Learning Platform, 2016)

Mögliche Klassifikation virtueller Realitäten (virtuelle Objekte gelb), eigene Darstellung nach Peddie, 2017, S. 201, 202